Media

AI吹き替えで動画制作が劇的に変わる|多言語対応・声質変換・リップシンクを自動化する方法

動画制作における吹き替え作業は、声優の収録、翻訳、編集、口パク調整など、多くの工程が必要でした。

しかし、AI技術の進化により、音声生成・多言語化・口パク同期(リップシンク)を自動処理できる「AI吹き替え」が急速に普及しています。

企業のプロモーション動画、YouTubeコンテンツ、アニメ、映画、教育教材など、あらゆる映像で活用が広がっており、低コスト・短時間での多言語展開が可能となりました。

本記事では、AI吹き替えの仕組み、活用方法、メリット、制作手順、注意点、今後の展望をわかりやすく解説します。

AI吹き替えとは?音声・翻訳・口パクを自動化する新しい吹き替え手法

AI吹き替えとは、音声認識・翻訳・音声生成・リップシンクといったAI技術を組み合わせ、映像の吹き替え作業を自動化する新しい手法です。

従来は声優やスタジオ収録が不可欠でしたが、AIの進化により短時間・低コストで多言語対応が可能になりました。

映画やアニメだけでなく、YouTubeや企業動画、教育コンテンツなど幅広い分野で導入が進んでいます。

従来の吹き替え作業の課題

従来の吹き替え制作は、高い品質を実現できる一方で、多くの課題を抱えていました。

まず、声優のキャスティングやスケジュール調整、スタジオ収録、編集作業など、工程が多く制作期間が長期化しやすい点が挙げられます。

特に多言語展開を行う場合、言語ごとに同様の工程が必要となり、時間と手間が大きく増加します。

また、声優の出演料やスタジオ費用などコスト面の負担も大きく、中小企業や個人クリエイターにとっては導入のハードルが高いのが実情でした。

さらに、グローバル配信を前提としたスピード感のあるコンテンツ制作には、従来の吹き替え手法が追いつかないケースも増えています。

こうした背景から、より効率的な吹き替え手法が求められてきました。

AI吹き替えが注目される理由

AI吹き替えが注目される最大の理由は、「スピード」「コスト」「スケーラビリティ」を同時に実現できる点です。

AIを活用すれば、音声の文字起こしから翻訳、音声生成までを短時間で自動処理でき、数分〜数時間で多言語版の動画を作成できます。

また、人手による収録工程を大幅に削減できるため、制作コストを抑えられるのも大きな魅力です。

これにより、これまで吹き替えが難しかったSNS動画や社内向けコンテンツにも対応可能になりました。

さらに一度作成したAI音声を複数の動画で使い回せるため、ブランドやキャラクターの声を一貫して維持できる点も評価されています。

こうしたポイントが、急速な普及を後押ししています。

AI吹き替えが映像制作の現場で導入が進む背景

映像制作の現場でAI吹き替えが導入されている背景には、コンテンツ消費のグローバル化があります。

YouTubeや動画配信サービスでは、国や言語の壁を越えて視聴されることが当たり前になり、迅速なローカライズが競争力に直結します。

一方で、制作現場では人材不足や制作スケジュールの短縮といった課題も深刻化しています。

AI吹き替えは、こうした制約を補い、少人数でも多言語展開を可能にする手段として注目されています。

特に教育・マーケティング・企業研修など、情報伝達を重視する分野では、実用性の高さから導入が加速しているのです。

AI吹き替えでできること

AI吹き替えは、音声認識・翻訳・音声生成・リップシンクといった複数のAI技術を組み合わせ、映像の吹き替え工程を自動化できる手法です。

従来は専門的な人手と時間を要していた作業も、AIの活用によって効率化が進んでいます。

ここでは、AI吹き替えによって具体的に何ができるのか、音声生成や多言語対応、口パク同期といった主要な機能を中心に見ていきましょう。

AI音声生成(キャラ声・ナレーション)

AI音声生成では、テキストから自然な音声を作り出すTTS(Text to Speech)技術が活用されます。

近年のAIは抑揚や間、感情表現の再現精度が向上しており、ナレーションだけでなくキャラクター性のある声の生成も可能です。

特定の話者の声を再現する音声クローン技術を使えば、ブランドや登場人物の声を一貫して維持できます。

クローン技術を用いることにより、シリーズ動画や継続的なコンテンツ制作においても、安定した表現が実現します。

多言語翻訳+自然な音声生成

AI吹き替えでは、ニューラル機械翻訳と音声生成を組み合わせることで、多言語対応を効率化できます。

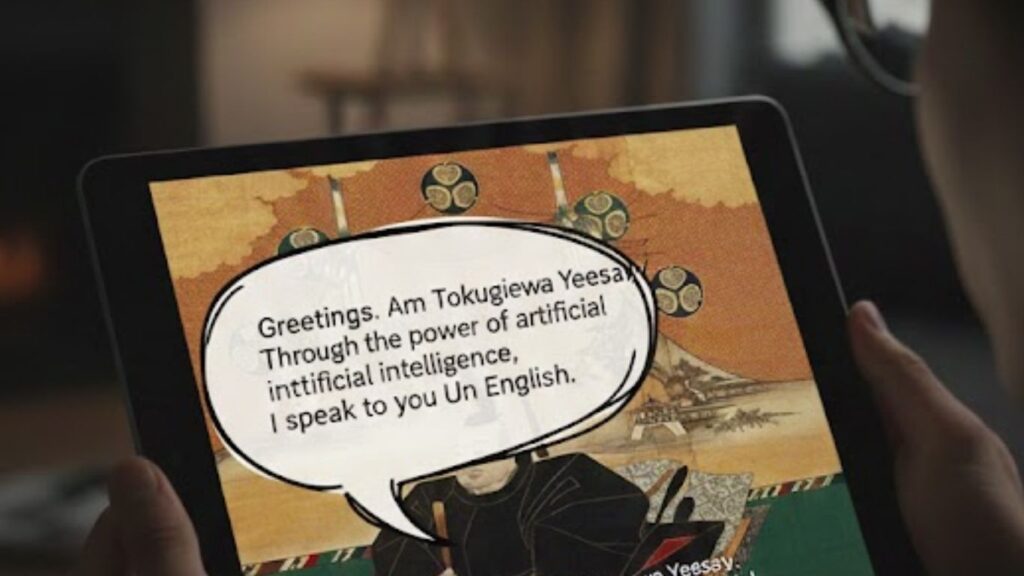

従来のコンピューターによる単なる直訳ではなく、文脈を考慮した自然な翻訳が可能になり、視聴者に違和感を与えにくい点が特徴です。

さらに翻訳後のテキストは即座に音声化されるため、言語ごとに声優を手配する必要がありません。

この2つの技術により、数十言語への同時展開も現実的になり、グローバル市場を視野に入れた映像戦略を強力に支援します。

AIリップシンクによる口パク同期

AIリップシンクは、生成された音声に合わせて口の動きを自動調整する技術です。

従来は編集者が手作業で調整していた工程をAIが担うことで、作業負担を大幅に軽減します。

近年の技術では、母音や子音の発音に応じた細かな口形状の制御が可能になり、視覚的な違和感も少なくなっています。

AIリップシンクにより、視聴者は吹き替え感を意識しにくくなり、没入感の高い映像体験を実現できます。

AI吹き替えの完成度を高める重要な要素として、今後さらに進化が期待されているのです。

AI吹き替えの活用シーン

AI吹き替えは、映像の音声と言語の壁を越え、作品や情報をより多くの人に届けるための実用的な技術として、活用が進んでいます。

YouTubeやSNSの動画配信から、企業のプロモーション映像、さらには映画やアニメといった映像作品まで、その導入シーンは多岐にわたります。

ここでは、AI吹き替えが実際にどのような場面で活用されているのか、代表的な3つのシーンを中心に見ていきましょう。

YouTube・SNS向け動画の多言語展開

YouTubeやSNS動画において、AI吹き替えはグローバル展開を加速させる手段として注目されています。

従来、多言語対応には字幕制作やナレーター手配が必要でしたが、AI吹き替えを使えば、元の音声をもとに複数言語の音声を短時間で生成できます。

さらに、リップシンク技術を組み合わせることで、話者の口の動きと音声が自然に一致し、視聴者に違和感を与えにくくなるのです。

とりわけインフルエンサーや個人クリエイターにとっては、制作コストを抑えながら海外視聴者へリーチできる点が大きなメリットです。

一度制作した動画を、多言語版として再活用できるため、コンテンツの寿命や価値も高まります。

AI吹き替えは、SNS時代のスピード感と相性の良い技術といえるでしょう。

企業プロモーション・サービス紹介動画

企業のプロモーション動画やサービス紹介映像においても、AI吹き替えは有効に活用されています。

例えば海外市場向けに動画を展開する場合、言語ごとにナレーションを収録し直すのは大きな負担でしたが、AIを使えば短期間で多言語対応が可能になります。

製品説明や操作解説といった情報重視の動画では、安定した音質と明瞭な発音を保てる点も強みです。

また、同一の映像・構成を保ったまま各国向けに展開できるため、ブランドイメージを統一しやすいというメリットもあります。

社内研修動画やマニュアル動画への応用も進んでおり、グローバル企業にとっては業務効率化と情報共有の両立を実現する手段として、AI吹き替えの導入が広がっています。

アニメ・映画・ショートムービーの吹き替え

アニメや映画、ショートムービーの分野では、AI吹き替えが映像表現そのものを進化させつつあります。

音声生成に加えて、俳優やキャラクターの口の動きや表情を自動調整する技術が進化し、従来の吹き替えで生じがちだった違和感を大幅に軽減できるようになりました。

これにより、作品の世界観や演技のニュアンスを保ったまま、多言語版を制作することが可能になります。

その中でも海外展開を前提とした作品や短編映像では、制作コストや期間を抑えられる点が大きな魅力です。

一方で、俳優や声優の権利、倫理面への配慮も重要となるため、適切なルールのもとでの活用が求められています。

AI吹き替えは、映像作品の国際展開を支える新たな選択肢として定着しつつあるのです。

AI吹き替えの導入メリット

AI吹き替えは、映像コンテンツの制作・配信における課題を一気に解決する実用的な技術として注目されています。

従来の吹き替えと比べ、制作コストや時間を大幅に削減できるだけでなく、少人数でも多言語展開が可能になる点が大きな特徴です。

さらに、音声品質を統一することでブランドイメージの一貫性も保てます。

ここでは、AI吹き替えを導入することで得られる代表的な3つのメリットを詳しく見ていきましょう。

制作コスト・時間を大幅削減

AI吹き替え最大のメリットは、制作コストと制作時間を大幅に削減できる点です。

従来の吹き替えでは、翻訳者や声優の手配、スタジオ収録、音声編集、口パク調整など、多くの工程と専門スタッフが必要でした。

その結果、1本の動画を多言語化するだけでも高額な費用と数日〜数週間の制作期間が発生していました。

一方、AI吹き替えでは、音声認識・翻訳・音声生成・リップシンクまでを一括で自動処理できます。

動画をアップロードし、言語を指定するだけで吹き替え版が生成されるため、作業時間は数十分〜数時間程度に短縮されます。

これにより、これまでコストや納期の制約から多言語対応を諦めていた企業やクリエイターでも、現実的に導入できるようになりました。

スピードとコスト効率を重視する現代の映像制作において、AI吹き替えは非常に相性の良い選択肢です。

少人数で大量の多言語コンテンツを作成可能

AI吹き替えは、少人数の体制でも大量の多言語コンテンツを制作できる点で、従来の制作フローを大きく変えます。

これまで多言語展開を行うには、言語ごとに外注先や声優を手配する必要があり、管理工数も膨大でした。

そのため、大企業以外では継続的な運用が難しいのが実情でした。

しかしAIを活用すれば、1本の元動画から複数言語の吹き替え音声を同時に生成できます。

担当者は最終チェックに集中でき、翻訳や収録の進行管理に追われることがありません。

このメリットにより、マーケティング動画、教育コンテンツ、SNS用の短尺動画などをスピーディーに量産できます。

グローバル市場を視野に入れた情報発信を、最小限のリソースで実現できる点は、AI吹き替えならではの大きな強みです。

声の品質を統一しブランドイメージを保てる

AI吹き替えは、声の品質やトーンを統一しやすく、ブランドイメージを維持できる点でも優れています。

従来の吹き替えでは、言語や声優が変わることで、動画ごとに声の印象が異なり、ブランドの一貫性が損なわれるケースも少なくありませんでした。

AI音声では、特定の声質や話し方を設定し、複数の動画や言語にわたって同じトーンを再現できます。

AI音声の設定により、企業の公式ナレーションやキャラクターの声を統一でき、視聴者に安定した印象を与えられます。

特にプロモーション動画やサービス紹介、継続配信するコンテンツでは、この一貫性が信頼感の向上につながるのです。

このようにAI吹き替えは、効率化だけでなく、ブランド価値を守る手段としても有効です。

AI吹き替えの制作手順

AI吹き替えは、複数のAI技術を段階的に組み合わせることで成り立っています。

音声の文字起こしから翻訳、音声生成、口パク調整までを一連の流れとして設計することで、効率的かつ自然な吹き替えが可能になります。

従来は専門知識が必要だった工程も、現在ではツールの進化により自動化が進みはじめました。

ここでは、AI吹き替えがどのような手順で制作されているのか、代表的なワークフローを順を追って見ていきましょう。

セリフ抽出(自動文字起こし)

AI吹き替えの最初の工程は、元動画に含まれるセリフの抽出です。

これは主に音声認識AIを用いた自動文字起こしによって行われます。

動画ファイルから音声データを分離し、人の声を検出したうえで、発話内容をテキスト化するのです。

近年の音声認識技術は精度が向上しており、専門用語や話し言葉も比較的正確に認識できるようになっています。

さらに、話者分離技術を活用することで、「誰が・いつ・どのセリフを話しているのか」を区別することも可能です。

区別することにより、複数人が登場する動画でもセリフ単位で管理しやすくなります。

抽出されたテキストは、後続の翻訳や音声生成の基礎データとなるため、誤認識があればこの段階で修正することが重要です。

この工程の精度が、最終的な吹き替え品質を大きく左右します。

翻訳とAI音声生成

セリフの文字起こしが完了したら、次は翻訳とAI音声生成の工程に進みます。

翻訳では、機械翻訳AIを用いて元言語からターゲット言語へとテキストを変換します。

ただ直訳するだけでなく、意味やニュアンスが自然に伝わるように調整することが重要です。

とりわけ映像コンテンツでは、翻訳文の長さが発話時間に影響するため、尺を意識した表現が求められます。

翻訳後のテキストをもとにAI音声合成によって吹き替え音声を生成します。

声質や話速、イントネーションを設定することで、ナレーション向き・会話向きなど用途に応じた音声を作成できます。

近年は感情表現や抑揚にも対応したAI音声が増えており、人の声に近い自然な仕上がりが可能です。

ここでは、翻訳と音声生成を一体で考えることが、違和感の少ない吹き替えにつながります。

口パク同期と最終ミキシング

AI吹き替えの仕上げとなるのが、口パク同期と最終ミキシングです。

生成した音声をそのまま映像に重ねるだけでは、口の動きと音声がずれてしまうことがあります。

そのため、リップシンク技術を用いて発話のタイミングを映像に合わせて微調整します。

近年はAIが口の動きを解析し、自動で同期させる技術も実用化されています。

また、吹き替え音声と元動画のBGMや効果音を自然に馴染ませるため、音量バランスや音質の調整も欠かせません。

これが最終ミキシング工程です。

音声が前に出すぎたり、逆に埋もれたりしないよう全体を整えます。

こうした調整を経ることで、視聴者が違和感なく映像に集中できる吹き替え動画が完成します。

ここまでが、AI吹き替えの基本的な制作ワークフローです。

AI吹き替え導入時の注意点

AI吹き替えは、動画を多言語展開するうえで非常に有効な手段ですが、導入にあたっては慎重に確認すべきポイントも存在します。

技術的にできることと、実務や倫理の観点でやってよいことは必ずしも一致しません。

特に声の権利や翻訳品質、音声の自然さは、視聴体験やブランド価値に直結します。

ここでは、AI吹き替えを導入する前に押さえておきたい代表的な注意点について整理していきましょう。

声の権利・著作権の確認

AI吹き替えを導入する際、最も重要なのが声の権利と著作権の確認です。

AI音声は、実在の声優や話者の声を学習データとして生成されるケースがあります。

そのため、本人の許諾なく声を再利用・模倣することは、肖像権やパブリシティ権、契約違反につながる可能性があります。

また、映画・アニメ・企業動画などでは、映像そのものだけでなく音声の二次利用が契約で制限されている場合もあります。

オリジナル音声を翻訳・加工して使用する行為が、著作権上問題ないかを事前に確認することが不可欠です。

特に商用利用や広告用途では、後からトラブルに発展するケースも少なくありません。

AI吹き替えは便利な技術ですが、「誰の声を、どこまで、どの目的で使うのか」を明確にし、契約や利用規約を確認したうえで導入することが重要です。

技術導入よりも先に、法的・倫理的な整理を行う姿勢が求められます。

AI音声の不自然さを調整する必要

AI音声は年々進化していますが、人間の声と比べると不自然さが残るケースもあります。

例えば、感情表現が単調になったり、抑揚が不自然だったりすると、視聴者に違和感を与えてしまいます。

特にドラマ性のある映像や、感情訴求を重視するプロモーション動画では、この違和感が作品全体の印象を左右します。

そのため、AIが生成した音声をそのまま使用するのではなく、話速や間、イントネーションを微調整する工程が重要になります。

場合によっては、一部を人の手で修正したり、ナレーション用途と会話用途で音声モデルを使い分けるといった工夫も必要です。

AI吹き替えは「完全自動で完璧に仕上がるもの」ではありません。

どこまでAIに任せ、どこを人が補正するのかを設計することが、品質を担保するうえでのポイントとなります。

翻訳のニュアンスズレ・品質管理

AI吹き替えでは、翻訳品質の管理も大きな課題です。

機械翻訳はスピードとコスト面で優れていますが、文化的背景や文脈、感情のニュアンスまでは完全に再現できないことがあります。

特に比喩表現やジョーク、マーケティング表現では、ニューラル機械翻訳でも意味のズレが生じやすくなります。

さらに、翻訳文は音声として読み上げられるため、「文章として正しいか」だけでなく、「話し言葉として自然か」という視点も欠かせません。

テキスト上では問題なくても、実際に音声化すると不自然に聞こえるケースも多くあります。

このような問題に対しては、AI翻訳後のチェックやポストエディット(人による確認・修正)を行い、品質管理の工程を組み込むことが重要です。

AI吹き替えを成功させるには翻訳を単なる自動処理で終わらせず、人の目と耳で最終確認する体制が不可欠です。

AI吹き替えの今後の展望

AI吹き替えは、実験的な技術の段階を超え、実用フェーズへと確実に進みつつあります。

動画配信プラットフォームやSNS、企業の映像活用が拡大する中で、「言語の壁をいかに取り除くか」は重要なテーマになっています。

今後は単なる翻訳手段ではなく、視聴体験そのものを変える技術として進化していくでしょう。

ここではAI吹き替えが今後どのように普及し、映像体験をどう変えていくのか、その展望を見ていきます。

映像作品の自動多言語化が一般化

今後のAI吹き替えにおいて大きな変化となるのが、映像作品の自動多言語化が一部のメディア大手による特別な施策ではなく、標準的な工程になる点です。

これまでは、海外展開を前提とした映画や一部の大規模コンテンツのみが多言語吹き替えの対象でした。

しかしAIの進化により、YouTube動画やSNS向けの短尺コンテンツ、社内向けの動画資料なども、公開と同時に複数言語へ展開できる環境が整いつつあります。

1本の動画を制作すれば、AIが自動で翻訳・音声生成を行い、言語別の吹き替え版を短時間で生成できるようになります。

スピーディーな多言語化により、制作者は言語ごとの制作負担を意識せず、内容そのものに集中できます。

特にグローバル市場を意識する企業やクリエイターにとっては、最初から世界向けに発信することが当たり前の選択肢になるでしょう。

一方で、すべてを完全自動に任せるのではなく、用途や作品の重要度に応じて人のチェックを組み合わせる運用が主流になると考えられます。

ただ、そのようなチェックは必要なものの、AIによる自動多言語化は、映像制作の前提条件そのものを変えていく存在になりつつあります。

視聴者に合わせたリアルタイム吹き替え

AI吹き替えのもう一つの進化として注目されているのが、視聴者に合わせたリアルタイム吹き替えです。

その代表例が、動画プラットフォームで試験的に導入が進む自動音声ダビング機能です。

視聴者の言語設定や地域情報に応じて、同じ動画でも再生時に異なる言語の吹き替え音声が自動で適用される仕組みが登場しています。

この仕組みが進化すれば、制作者が個別に言語版を用意しなくても、視聴者側の環境に合わせて最適な言語でコンテンツが届けられるようになります。

例えばライブ配信やスポーツ中継、ニュース動画などでもリアルタイム翻訳と吹き替えが組み合わさることで、世界中の視聴者が同時に内容を理解できる未来が現実味を帯びてきました。

ただし現時点では、感情表現の乏しさや抑揚の不自然さ、意図しない言語への自動切り替えなど、課題も残っています。

そのため、制作者側が吹き替えの適用可否を選択できる設計や、用途に応じた使い分けが重要になります。

リアルタイムAI吹き替えは、利便性と表現品質のバランスを取りながら進化していく分野と言えるでしょう。